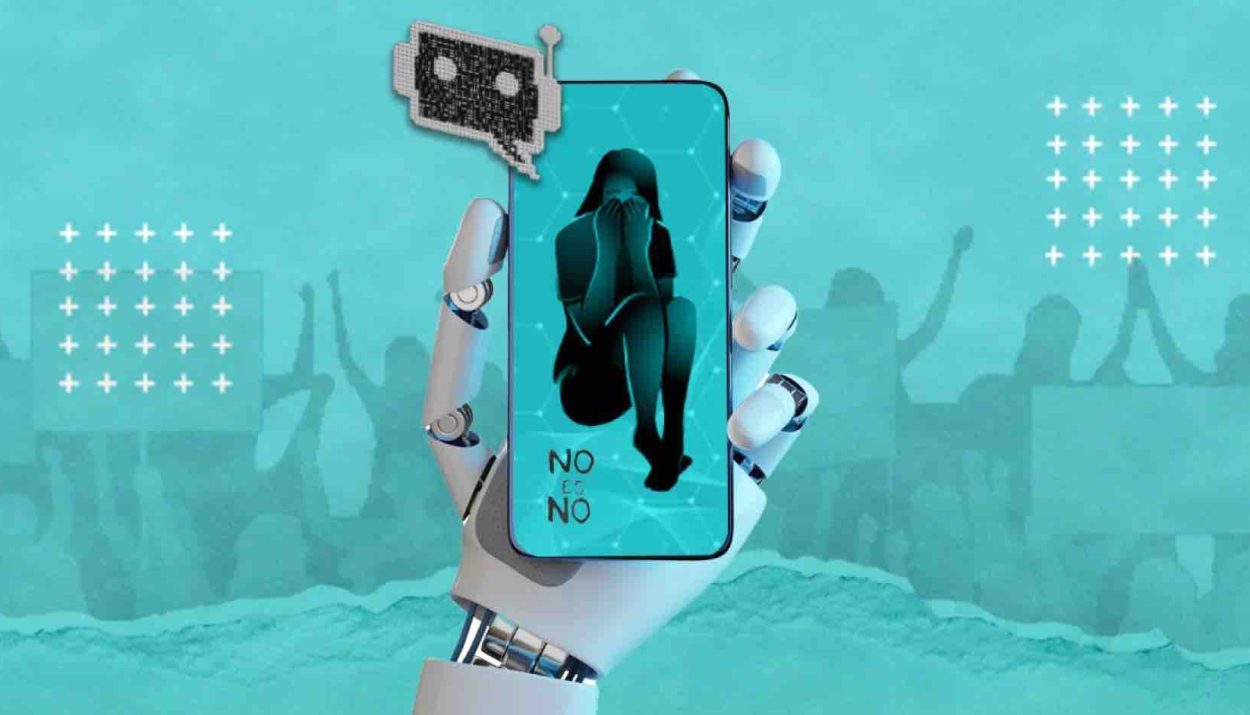

La violencia digital en México ha evolucionado con el uso de la inteligencia artificial (IA), permitiendo nuevas formas de agresión contra las mujeres.

Según el Frente Nacional para la Sororidad, entre 2019 y 2023 se abrieron 8,854 carpetas de investigación por delitos contra la intimidad sexual, pero solo dos derivaron en sentencia. Aún no existe una resolución judicial que contemple el uso de IA en estos casos.

Un caso emblemático ocurrió en diciembre de 2024, cuando un tribunal de la Ciudad de México absolvió a Diego “N”, un ex estudiante del IPN acusado de alterar y vender imágenes falsas de sus compañeras haciéndolas parecer desnudas.

La abogada de las víctimas, Valeria Martínez, explicó que el juez reconoció el delito, pero no encontró pruebas suficientes para condenarlo.

Falta de peritos y protocolos en IA

Martínez y otras defensoras han señalado la falta de especialistas en IA dentro del sistema judicial, lo que dificulta la investigación y sanción de estos delitos.

Actualmente, ni los tribunales locales ni la Suprema Corte de Justicia de la Nación cuentan con protocolos específicos para juzgar delitos cometidos con IA.

La abogada Leslie Jiménez advierte sobre una laguna jurídica en la materia, pues no hay mecanismos claros para demostrar que un acusado es responsable de la alteración de imágenes.

“Es urgente capacitar peritos que puedan identificar no solo la falsificación, sino también al responsable del delito”, enfatizó.

Las expertas hacen un llamado a las autoridades para establecer protocolos que permitan investigar y sancionar eficazmente estos casos, garantizando justicia para las víctimas.